允中 发自 凹非寺

把Agent接入工作流,本该是件提效的乐事。

但现实往往是:为了保住数据隐私,只能守着本地“智商有限”的小模型死磕;为了追求极致性能,又不得不眼睁睁看着云端API烧掉大把经费,还得时刻担心敏感信息在不经意间“裸奔”。

云端太危险,本地太鸡肋。难道开发者只能在“裸奔”和“人工智障”之间二选一?

破局者出现了。

清华大学THUNLP实验室、中国人民大学、AI9Stars、面壁智能与OpenBMB联手,给AI Agent装上了一个“智能交通指挥官”——ClawXRouter。

作为一个开源的端云协同AI智能体路由插件,它可以轻松适配OpenClaw生态。

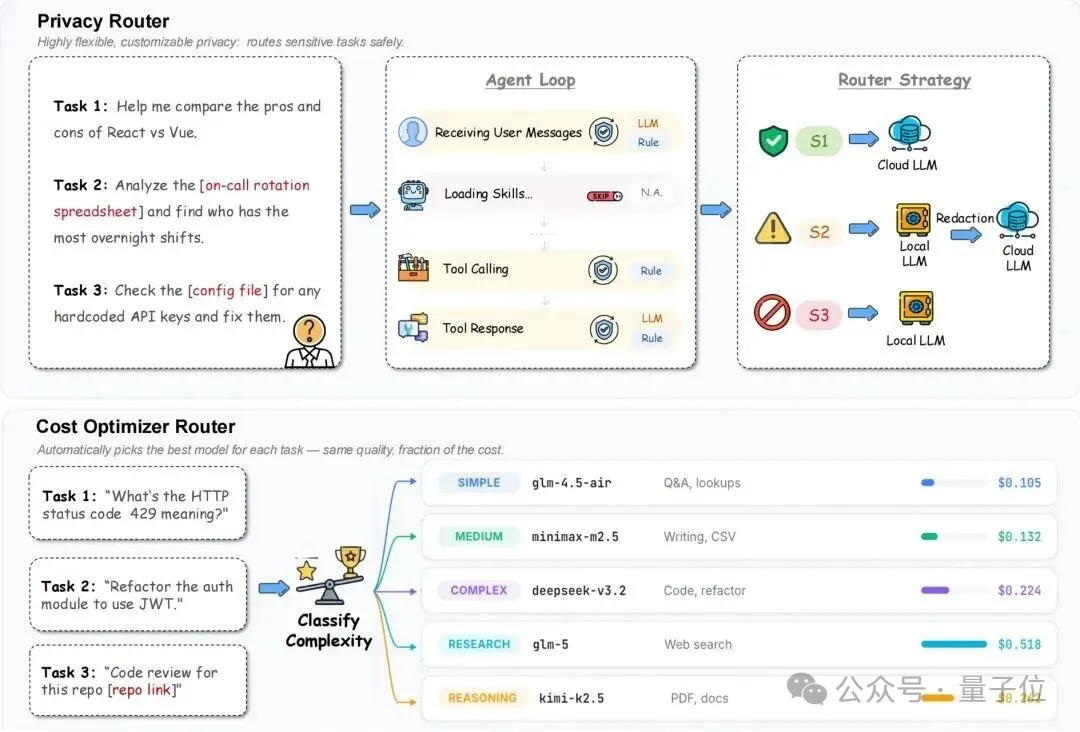

就像让Agent有了“分身术”一样,聪明地在本地和云端之间切换:简单的本地跑,敏感的脱敏做,复杂的交给云端。

ClawXRouter源于端云协同的智能体框架EdgeClaw——其内生具备三级隐私路由、性价比感知路由、智能脱敏转发、双轨记忆等完整的端云协同能力。

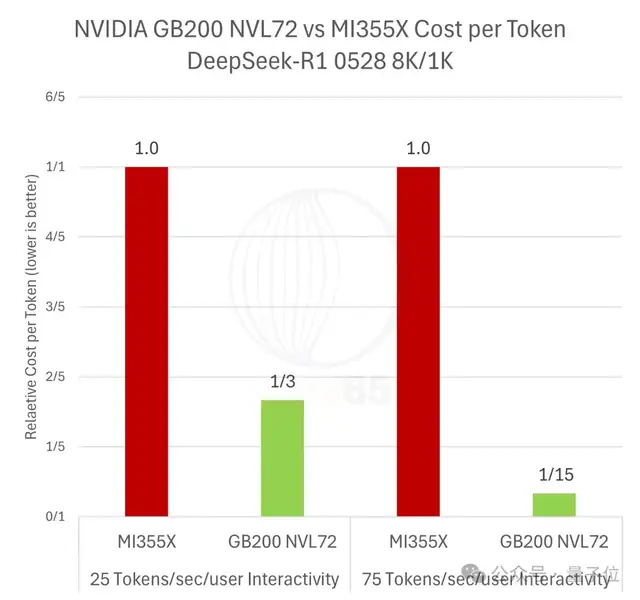

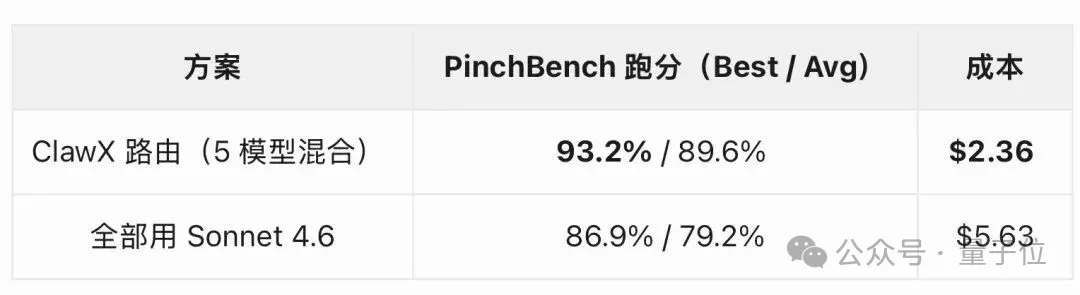

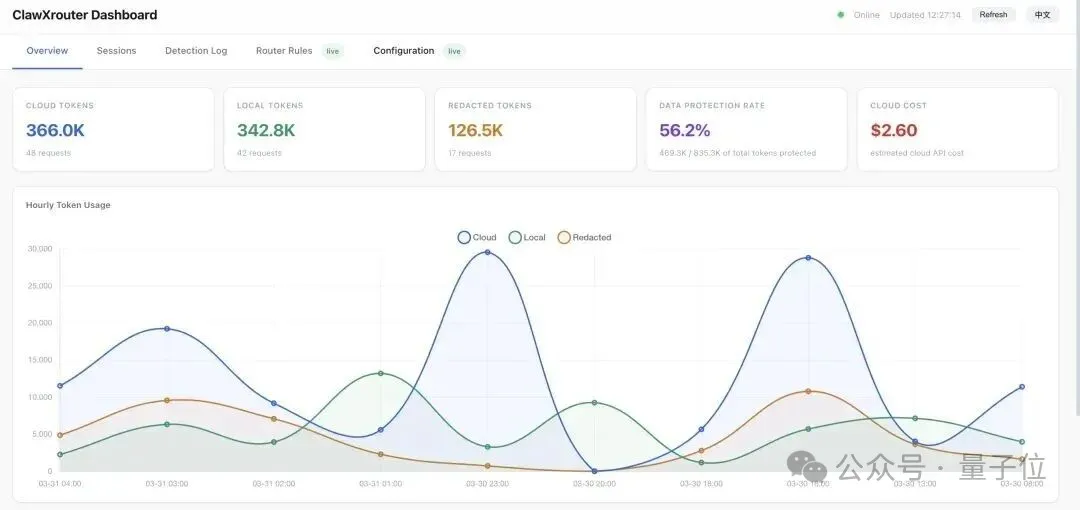

最新测评效果显示:使用ClawXRouter不仅让成本直降58%,性能反而还提升了6.3%。

事实上,这种“两头堵”的尴尬,正来源于当前Agent使用模式中难以调和的三大顽疾:

而ClawXRouter的出现,正是为了打通端云协同的最后一步:通过一套精妙的路由机制,为每一条请求找到最合适的路径。

这样一来,开发者无需改动一行业务代码,就能让AI Agent自动实现:

一个插件,丝滑实现端云协同,解决开发者“不敢用、用不起、用不好”的三大难题。

即使是Code Review这样的日常任务,也可能一不小心把API Key或数据库密码喂给云端模型。

ClawXRouter通过植入钩子(Hook),像安检一样自动扫描每一条消息、工具调用和Agent输出,并将其分为三级:

这背后是“规则+模型”双检测引擎在保驾护航,既快又准,能确保万无一失。

“航天级”模型如何干“拧螺丝”的活?

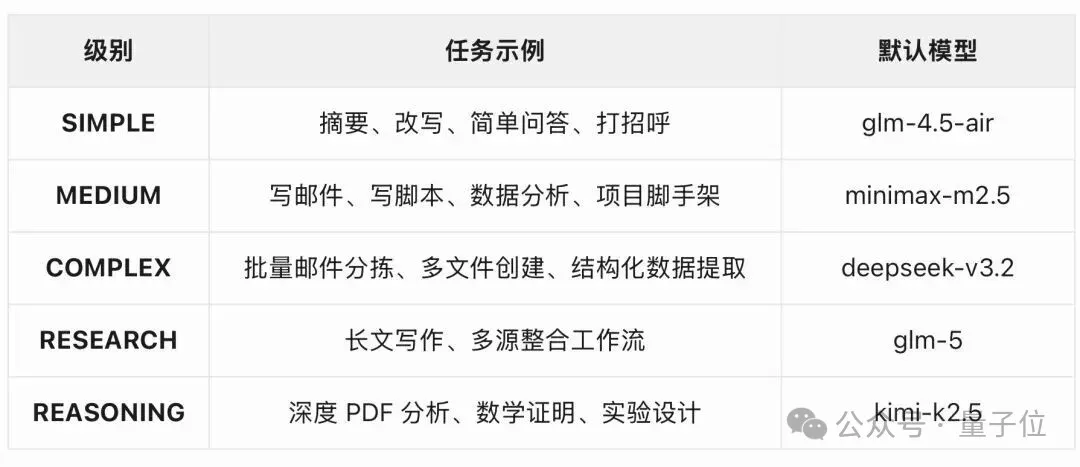

ClawXRouter内置了一个由本地小模型担当的“任务评估师”(LLM-as-Judge)。它会快速判断任务复杂度,然后将请求分发给最合适的模型。

效果如何?在PinchBench(包含23项OpenClaw Agent基准测试)上跑了一下:

结论是:成本节省58%,性能反而提升6.3%。

当一项任务既包含敏感信息、又需要云端模型的强大推理能力时,怎么办?

这时,ClawXRouter的智能脱敏机制就派上了用场。

对于涉及敏感信息的复杂任务,本地模型能力不足时不必“硬扛”:

ClawXRouter会自动识别敏感信息并智能脱敏后,将脱敏后的任务安全交给云端处理。

同时,ClawXRouter巧妙地维护了双轨记忆与双轨会话机制:云端模型只能看到脱敏后的对话历史(`MEMORY.md`),本地则保留完整信息(`MEMORY-FULL.md`)。

这样既保护了隐私,又没有因为本地模型的瓶颈而卡住工作流,从根本上杜绝隐私数据通过上下文窗口泄露给第三方服务的风险。

每个开发者与团队的需求都不同。为此,ClawXRouter提供了:

云侧不敢用、用不起,端侧用不好?

ClawXRouter的答案是:

不必二选一,让端侧和云侧各尽其能。

项目将持续开源迭代,欢迎开发者与行业伙伴参与贡献,共同构建安全高效的端云协同Agent生态。

GitHub开源链接:https://github.com/Openbmb/ClawXRouterClawHub链接:https://clawhub.ai/plugins/clawxrouter

版权声明:

本博客部分内容为转载文章,旨在分享有价值的信息,版权归原作者所有。

转载仅为个人学习与交流目的,不对文章观点负责,亦不用于任何商业用途。

如涉及版权问题,请联系本人删除。