这波更新,满眼都是Coding,Coding,还是Coding

2025倒计时,新SOTA模型涌现没有放缓迹象。

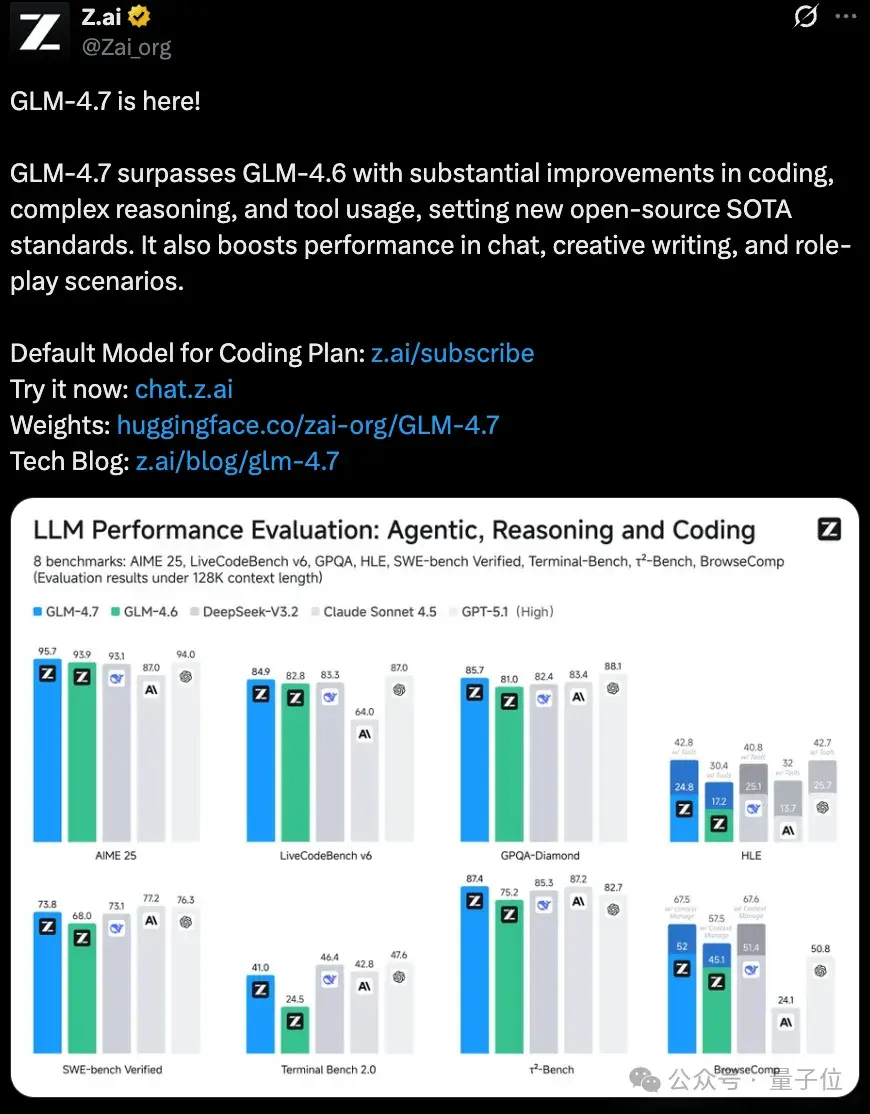

一夜之间,编程SOTA模型易主,而且上线即开源,依然来自中国大模型公司——

智谱AI,GLM-4.7。

这波更新,技术报告里满眼都是Coding,Coding,还是Coding。

而能力的提升,带来的最直观效果是:

AIME 25和人类最后考试(HLE)等基准中,GLM-4.7分数超GPT-5.1;

SWE-Bench分数达(73.8%,+5.8%),创开源新高。

官方Demo显示,写个植物大战僵尸不费劲:

总而言之,模型这么一发,双旦的节庆氛围一下到位了(doge)。

官网Chatbot和API均已就为,现在就能在线开玩。

在前端生成质量上,GLM-4.7展现出明显升级:页面结构更干净、组件层级更清晰。

相比GLM-4.6,更像是现代的Web UI,网友元素中更加美观。

在PPT与视觉物料生成方面,GLM-4.7标题层级明确、元素尺寸更合理。

在复杂几何结构与空间关系的表达上,GLM-4.7模型能够保持较好的结构一致性与细节稳定性。

3D资产的生成质量也有显著提升。

这次最新的模型主打编程,相较前代GLM-4.6,GLM-4.7在编码能力、交互体验与复杂推理等多个维度实现了系统性升级。

此外,GLM-4.7在对话、创意写作、角色扮演等场景中同样有提升,系统性增强了编码、推理与工具使用能力。

技术方面,GLM-4.7强化了自GLM-4.5起引入的交错式思考(Interleaved Thinking),并进一步引入了保留式思考(Preserved thinking)和轮级思考(Turn-level Thinking)。

GLM在工具调用之间、收到工具结果之后继续思考。

这让模型能够进行更复杂的分布推理,提升了指令遵从和生成质量:

在决定下一步行动前先解读每次的工具输出,把多次工具调用和推理步骤串联起来,并根据中间结果做出更细粒度的决策。

在编码场景中,GLM-4.7引入了一种新的思考模式:

模型会自动在多回合对话中保留所有思考快,复用已有推理而不是从头重新推理。这减少了信息丢失和不一致性,使得模型更适用于长程、复杂任务。还能在真实任务中节省更多tokens。

轮级思考是一种按轮控制推理计算的能力,即在同一个会话中,每一轮请求都可以独立选择开启/关闭思考。

这使得GLM-4.7具备以下优势:

更多技术详情,智谱官方也附上了详细技术报告。

BTW,智谱这个月还真上了“节日限定优惠”。

每月最低20元即可畅享GLM-4.7,用上Claude Pro套餐3倍用量。

又是一位好价格屠夫呀。

而且GLM-4.7的深夜炸场,也算是已经冲刺IPO上市的智谱,带来的最新技术证明。

目前智谱已经通过了港交所上市聆讯,IPO敲钟仅剩下最后100米。

而GLM-4.7可能也是智谱上市之前,最重要的模型更新了……吧?

参考链接:

[1]https://z.ai/blog/glm-4.7

[2]https://x.com/Zai_org/status/2003156119087382683

版权声明:

本博客部分内容为转载文章,旨在分享有价值的信息,版权归原作者所有。

转载仅为个人学习与交流目的,不对文章观点负责,亦不用于任何商业用途。

如涉及版权问题,请联系本人删除。